中国工程院院士方滨兴:内生安全问题可能成为人工智能“死穴”

原标题:中国工程院院士方滨兴:内生安全问题可能成为人工智能“死穴”

从自动驾驶到智能家居,近两年,人工智能技术和应用发展迅速,科幻电影中曾经描绘的“人机共存”时代,似乎离人类越来越近。然而,人工智能足够安全吗?4月20日,在2019西湖论剑·网络安全大会上,中国工程院院士倪光南、邬江兴、方滨兴和杨小牛,表达了他们对人工智能潜在风险的思考和隐忧。

中国工程院院士共话网络安全。

25年前的今年,中国全功能接入国际互联网,就此拉开中国互联网的发展序幕,全社会的经济、文化、生活方式迎来深刻变革。

中国工程院院士邬江兴仍然记得当年的场景。他说,大家感到“欢新鼓舞”,各行各业都在倡导“互联网+”。但在发展伊始,网络安全问题没有得到足够重视,导致了现在的很多遗留问题。

2014年,中共中央总书记习近平在中央网络安全和信息化领导小组第一次会议上强调,网络安全和信息化是一体之两翼、驱动之双轮,必须统一谋划、统一部署、统一推进、统一实施。做好网络安全和信息化工作,要处理好安全和发展的关系,做到协调一致、齐头并进,以安全保发展、以发展促安全,努力建久安之势、成长治之业。

邬江兴深以为然。但他也坦言,同步安全和发展,对于全人类而言都是挑战。如今,人工智能应用正像互联网一样进入日常生活,各行各业须及早考虑人工智能的安全问题,否则就会重走当年的老路。“不管是什么问题都会有副作用,必须在发展的初期来解决。”他说。

中国工程院院士杨小牛,也有类似担忧:“人工智能会不会又像互联网一样,刚开始不考虑它自身的安全,最后发现存在各种各样的问题,面临相当大的风险?”他认为,将来,如何让算法更加安全、可靠,是一个突出问题。

中国工程院院士方滨兴提出,人工智能的内生安全问题,可能成为其“死穴”。例如,一个被贴上几张小广告的停车标志牌,人看到标志牌会觉得毫无差别,但算法识别就会出现错误。

方滨兴介绍,这样的错误,与人工智能的内生原理有关。人工智能靠大量的数据和神经网络学习,人能够看到人工智能的处理结果,但神经网络中还有很多人看不到的隐含层。因此,几个小广告,甚至是像素点的改变,都会导致人工智能处理错误。

“现在要关注网络安全的新挑战”,中国工程院院士倪光南说,新技术带来了许多传统安全领域没有的新问题、新现象,必须予以重视。以自动驾驶汽车为例,如果黑客通过网络攻击获得了控制权,自动驾驶汽车就会变得非常危险。

采写:南都记者冯群星 蒋琳

作者:冯群星 蒋琳

(责任编辑:张雨生)

-

定了!庆祝海军成立70周年 海上阅兵23日举行 10余国派舰艇参加

但是更多的时间,投资人充当着中介的角色。...[详细]

但是更多的时间,投资人充当着中介的角色。...[详细]

-

而传统媒体能触达20万人,可能就是全国在这个细分领域里面的第一了。...[详细]

而传统媒体能触达20万人,可能就是全国在这个细分领域里面的第一了。...[详细]

-

他们认识很多圈内投资人,可是真到自己创业,却发现人情牌并不好打,两个月几十份BP发出去,没有一家愿意投。...[详细]

他们认识很多圈内投资人,可是真到自己创业,却发现人情牌并不好打,两个月几十份BP发出去,没有一家愿意投。...[详细]

-

包括选科比作为我们的代言人也是因为勤奋,科比已经是巨星了,能在NBA打球就已代表至高荣誉。...[详细]

包括选科比作为我们的代言人也是因为勤奋,科比已经是巨星了,能在NBA打球就已代表至高荣誉。...[详细]

-

农村濒临灭绝的“老东西”,不见得多值钱,但农民看到就回忆满满

四、荒野中才有更多创新 著名经济学家、中欧国际工商学院的许小年教授曾说过一句话:“创新是荒郊野地的孤狼。...[详细]

四、荒野中才有更多创新 著名经济学家、中欧国际工商学院的许小年教授曾说过一句话:“创新是荒郊野地的孤狼。...[详细]

-

关键一点,我是在电影《保镖》中学到的。...[详细]

关键一点,我是在电影《保镖》中学到的。...[详细]

-

而你要做的,就是提前淘金“僵尸股”,然后默默埋伏,一旦有机会就出击。...[详细]

而你要做的,就是提前淘金“僵尸股”,然后默默埋伏,一旦有机会就出击。...[详细]

-

更多的是那些犹豫不决想继续支撑下去的人,在公司倒闭后回想起曾经一闪而过的机会时,难免留下一丝悔意,比如曾经有机会卖掉公司而选择了继续坚持下去的李进。...[详细]

更多的是那些犹豫不决想继续支撑下去的人,在公司倒闭后回想起曾经一闪而过的机会时,难免留下一丝悔意,比如曾经有机会卖掉公司而选择了继续坚持下去的李进。...[详细]

-

中情局旗下的一家投资机构,在公司成立第二年成了他们名义上的第一个客户,然后对方并不愿意和签署正式合同。...[详细]

中情局旗下的一家投资机构,在公司成立第二年成了他们名义上的第一个客户,然后对方并不愿意和签署正式合同。...[详细]

-

习近平同巴西联邦共和国总统举行会谈 两国元首一致同意推动中巴全面战略伙伴关系取得新的更大发展

该公司挂牌前的估值就超过33亿元。...[详细]

该公司挂牌前的估值就超过33亿元。...[详细]

4.21日运

4.21日运  习近平总书记在深度贫困地区脱贫攻坚座谈会上的重要讲话引起强烈反响

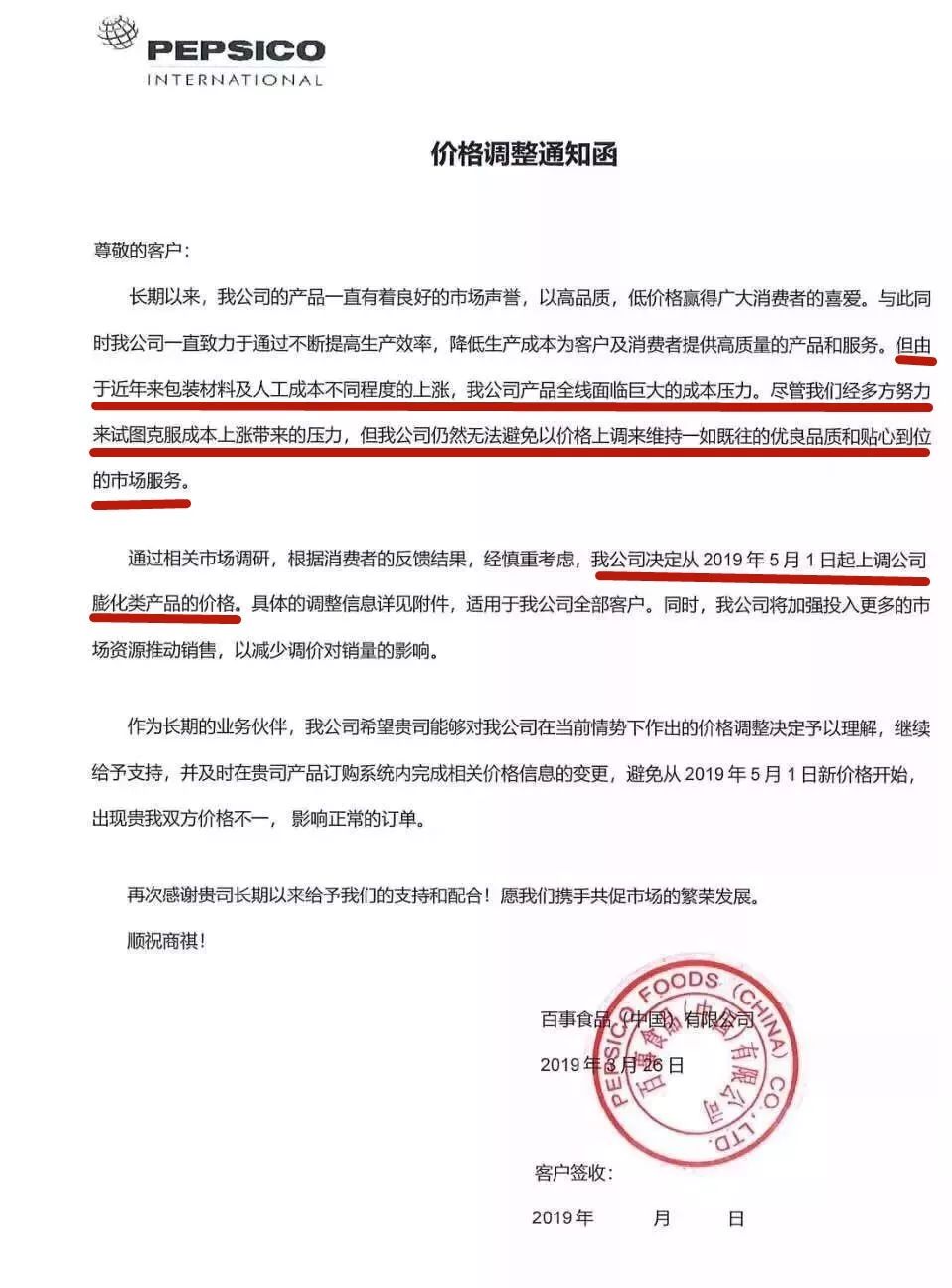

习近平总书记在深度贫困地区脱贫攻坚座谈会上的重要讲话引起强烈反响 下月起,你爱吃的这些食品要涨价了?!看完清单想哭

下月起,你爱吃的这些食品要涨价了?!看完清单想哭 习近平同巴西联邦共和国总统举行会谈 两国元首一致同意推动中巴全面战略伙伴关系取得新的更大发展

习近平同巴西联邦共和国总统举行会谈 两国元首一致同意推动中巴全面战略伙伴关系取得新的更大发展 春天多喝这道菌菇汤,我家隔天做一次,每次上桌一滴不剩!

春天多喝这道菌菇汤,我家隔天做一次,每次上桌一滴不剩!